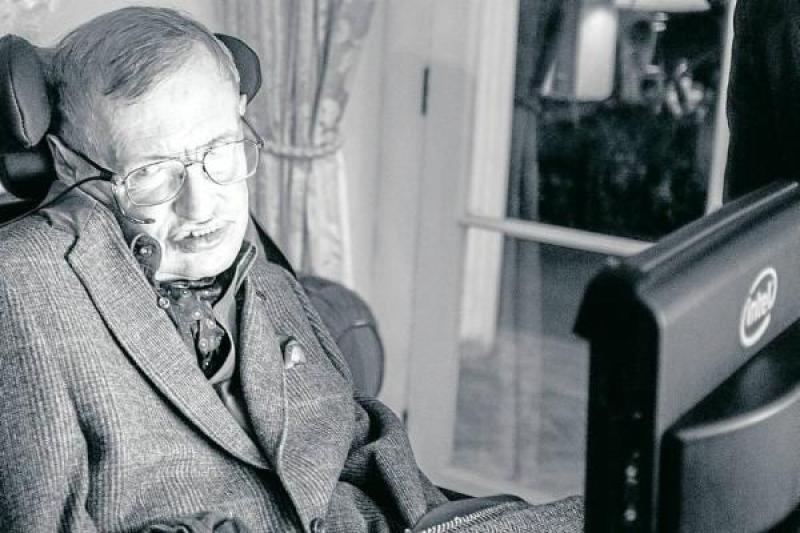

El científico Stephen Hawking teme que la tecnología pueda avanzar a un paso demasiado rápido para que la especie humana pueda competir con ella. Esto ocurriría precisamente cuando la especie humana deje de estar encargada de su mejoramiento, y los sistemas mismos puedan ocuparse a sí mismos de lo que requieren y sean cada vez más y más inteligentes.

Hawking no es el único pesimista respecto a las posibilidades que puede traer la creación de verdadera inteligencia artificial, aunque muchos de los científicos de la computación que han conseguido los mayores avances en esta área afirman que el peligro no es tan grande.

Avance demasiado rápido podría ser fatal

Ingenieros de software en Intel Labs diseñaron recientemente un sistema que aumenta la velocidad con que el científico Stephen Hawking puede comunicarse con su computador y, a través de él, con otras personas.

Pero además de estar agradecido por las nuevas tecnologías, Hawking está preocupado.

Precisamente Intel es una de las empresas que busca activamente desarrollar un sistema de inteligencia artificial capaz de emular la mente humana y, en muchos aspectos, superarla.

El primer prototipo del sistema se llama Watson y, en 2011, derrotó a dos competidores humanos en el programa norteamericano de preguntas y respuestas Jeopardy!. Sus contrincantes eran, además, ganadores recurrentes del programa y expertos en su modo de juego.

Los desarrolladores de Watson afirman que, al principio, enfrentaron una gran incredulidad por parte de colegas en el campo de la inteligencia artificial. Incluso algunos de ellos estaban inseguros.

Eric Brown, encargado de desarrollar los algoritmos de Watson, dice: “no sé si al principio creí que realmente competiríamos en Jeopardy!. Que identificaríamos los avances que nos permitirían traspasar las barreras de desempeño iniciales”, afirma. “Pero cuando Watson empezó a funcionar y el desempeño mejoró, se volvió una meta alcanzable. Y todo el proceso fue como una bola de nieve”.

Ese efecto de ‘bola de nieve’ del que habla Brown es precisamente lo que inquieta al profesor Hawking. La posibilidad de que, en un abrir y cerrar de ojos, la tecnología abrume completamente la raza humana e incluso llegue a destruirla.

El peligro: las máquinas que se reprograman

“El desarrollo de una inteligencia artificial completa podría ser fatal para la raza humana, porque esta podría reprogramarse a sí misma a una frecuencia cada vez mayor. Y los humanos, limitados por la evolución biológica, no podrían competir” afirma Hawking. La preocupación del físico británico por este problema se explica desde el área matemática.

Si bien es cierto que otras amenazas como el cambio climático o la posibilidad de una guerra nuclear parecen más inmediatas, Hawking teme que la evolución exponencial de la complejidad e inteligencia del software logre convertir a las máquinas en una amenaza para la especie humana, por así decirlo, de la noche a la mañana.

Hawking, sin embargo, es visto como un pesimista en el área.

Precisamente aquellos involucrados en la creación de sistemas de inteligencia artificial son quienes menos temor tienen a esta perspectiva.

“Creo que estaremos a cargo de la tecnología por un periodo decentemente largo, y que su potencial para resolver muchos de los problemas del mundo se materializará”, comenta Rollo Carpenter, científico creador del sistema Cleverbot.

Podemos crear una amenaza natural

Para Carpenter, que los sistemas de inteligencia artificial quieran destruirnos es tan posible como que decidan ayudarnos. Y por supuesto: existen escenarios alternativos.

En los años que faltan para que la inteligencia artificial sea desarrollada, los humanos pueden haberse integrado cada vez más con la tecnología.

El advenimiento de la inteligencia artificial encontraría entonces a seres humanos que ya son de por sí difíciles de diferenciar de los sistemas con que han ‘aumentado’ sus funciones.

En otras palabras: habría una asimilación, más que un exterminio.

Pero si Hawking es un pesimista, no es el único. Elon Musk, fundador de Tesla Motors y la empresa de exploración espacial privada SpaceX, también han catalogado a la inteligencia artificial como “nuestra más grande amenaza existencial”.

Musk, un inversionista en varios frentes de la investigación para desarrollar inteligencia artificial, describe su papel como alguien que quiere “estar al tanto de lo que está ocurriendo”, más que ser un impulsor irresponsable en el desarrollo de tecnologías que considera peligrosas.

“Cada vez estoy más inclinado a pensar que debería haber algún tipo de supervisión, tal vez a nivel nacional o internacional, así sea simplemente para asegurarnos de que no vamos a cometer una gran estupidez”, afirmó Musk durante una charla en el Massachusetts Institute of Technology.

Comentarios